Uno zaino con intelligenza artificiale permette ai non vedenti di muoversi più facilmente

Il ricercatore Jagadish K. Mahendran dell’Institute for Artificial Intelligence dell’Università della Georgia, insieme a un gruppo di collaboratori, ha progettato uno zaino con intelligenza artificiale e attivazione vocale che può aiutare i non vedenti a muoversi e percepire il mondo che li circonda. Lo zaino ha il compito di rilevare segnali stradali, ostacoli sospesi, strisce pedonali, oggetti in movimento e variazioni di quota, il tutto in modo efficiente.

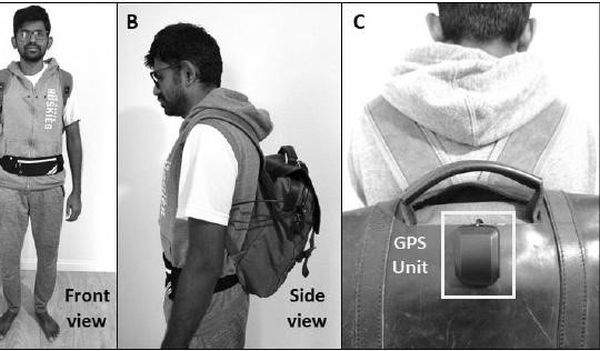

All’interno dello zaino trovano posto un’unità GPS insieme a un computer, ad esempio un notebook, mentre la persona non vedente o con gravi disabilità visive non deve far altro che indossare un giubbotto dotato di una fotocamera intelligente e una sorta di marsupio in cui c’è un pacco batteria capace di alimentare il sistema per circa otto ore.

Il cuore di questo sistema è una fotocamera spaziale Luxonis OAK-D con intelligenza artificiale (si basa su una VPU Intel Movidius e il toolkit Intel Distribution of OpenVINO) inserita nel giubbotto e collegata al computer nello zaino. Tre piccoli fori nel giubbotto consentono a OAK-D di vedere il mondo esterno.

OAK-D è in grado di eseguire reti neurali avanzate fornendo allo stesso tempo funzioni di visione artificiale accelerate e una mappa di profondità in tempo reale: si basa infatti su due videocamere stereoscopiche e una in grado di riprendere a risoluzione 4K.

Un auricolare Bluetooth permette alla persona non vedente di interagire con il sistema tramite domande e comandi vocali e il sistema risponde con informazioni verbali. Mentre la persona si muove nell’ambiente, il sistema trasmette in modo udibile le informazioni sugli ostacoli comuni, inclusi segnali, rami degli alberi e pedoni. Avvisa anche di imminenti strisce pedonali, marciapiedi, scale e ingressi.

“L’anno scorso, quando ho incontrato un amico ipovedente, sono rimasto colpito dall’ironia della situazione: insegnavo ai robot a vedere, ma ci sono molte persone che non possono vedere e che hanno bisogno di aiuto. Questo mi ha motivato a costruire il sistema di assistenza visiva”, ha dichiarato Mahendran.

L’OMS stima che in tutto il mondo vi siano 285 milioni di ipovedenti. I sistemi di assistenza visiva per muoversi nell’ambiente sono piuttosto limitati e vanno dalle app per smartphone con assistenza vocale basate sul GPS a bastoni da passeggio intelligenti con una fotocamera. Questi sistemi mancano della percezione della profondità necessaria per rendere gli spostamenti dei disabili visivi sicuri e totalmente indipendenti: questo progetto statunitense mostra che è possibile fare molto di più e che gli strumenti tecnologici sono già disponibili. Basta usarli.

Fonte: http://feeds.hwupgrade.it/