Anthropic lancia l’allarme: l’IA sarà presto autoreplicante

Dario Amodei, CEO di Anthropic, ha sollevato un allarme abbastanza inquietante riguardo al potenziale sviluppo incontrollato dell’intelligenza artificiale: nel giro di pochi anni, se non forse già dal prossimo, l’IA potrebbe avere la capacità di essere “autosufficiente” e “autoreplicante”.

Amodei ha espresso le proprie considerazioni in occasione di una recente intervista al podcast di Ezra Klein del New York Times, cogliendo inoltre l’occasione per ricordare l’approccio che Antrhopic stessa adotta nello sviluppo dei modelli di Intelligenza Artificiale, che la società aveva illustrato alla fine dello scorso anno.

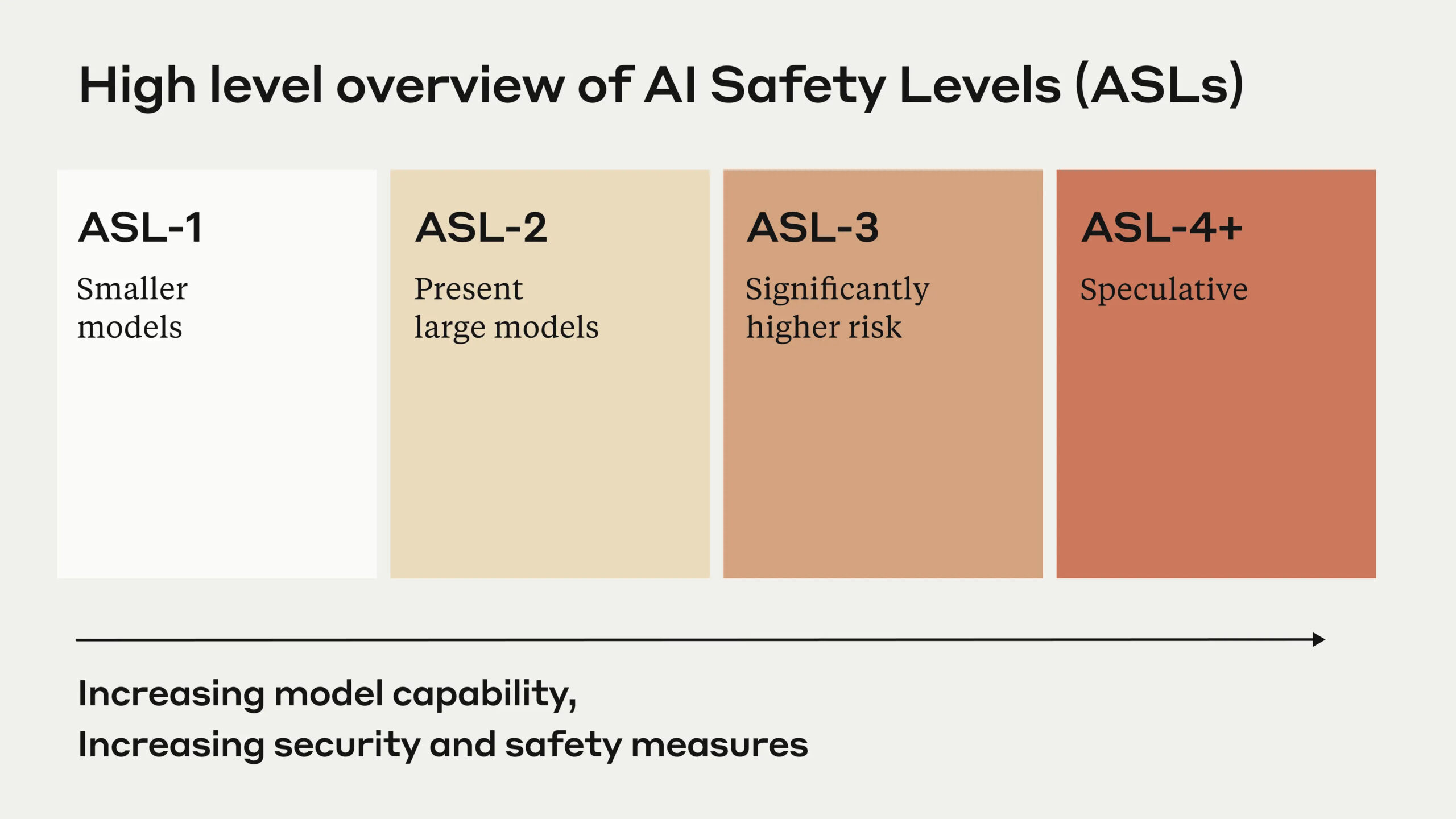

Secondo Amodei il mondo attualmente si trova al livello 2 di questa classificazione, ma il livello 4 – cioè quello in cui è particolarmente elevato il rischio di uso e comportamento catastrofico e la potenziale autonomia dei modelli – potrebbe essere raggiunto tra il 2025 e il 2028.

Il livello 4 implica una particolare attenzione verso l’uso (e possibile abuso) concreto dei modelli IA in particolare da parte degli Stati, che è ovviamente un compito molto più difficile e complesso rispetto alla prevenzione degli abusi da parte dei singoli infividui. Si tratta di una prospettiva, secondo Amodei, particolarmente preoccupante poiché potrebbe consentire a stati come Corea del Nord, Cina o Russia di potenziare notevolmente le loro capacità offensive attraverso l’IA, con serie implicazioni geopolitiche.

Ma al di là dei possibili impieghi potenzialmente catastrofici dell’IA, il livello 4 è anche lo scenario in cui l’Intelligenza Artificiale può avere capacità di replicarsi e sopravvivere “in natura”, acquisendo un’autonomia che la porterebbe a sfuggire al controllo umano. Si tratta di una prospettiva tutt’altro che rassicurante e che richiede un approccio normativo e operativo responsabile, con un’attenta analisi dei rischi. “Non sto parlando di qualcosa che avverrà fra 50 anni, ma del futuro prossimo” ha affermato Amodei per sottolineare il senso di urgenza nell’affrontare adeguatamente lo sviluppo delle IA.

Per quanto dichiarazioni simili portino a prefigurare gli scenari più foschi tratteggiate in varie opere di fantascienza (qualcuno ha detto Skynet?) e, proprio per questo motivo, spesso vengano considerate come esagerate, va comunque tenuto presente che Amodei è una figura prominente nel panorama dell’intelligenza artificiale, avendo lavorato direttamente allo sviluppo di GTP-3 presso OpenAI e successivamente fuoriuscito con altri ex-dipendenti per fondare Anthropic con l’obiettivo di “garantire che l’intelligenza artificiale trasformativa aiuti le persone e la società a prosperare”.

E’ chiaro che l’approccio allo sviluppo di uno strumento con potenzialità tali non può essere lasciato al senso di etica e responsabilità dei singoli attori del panorama IA, ma implica un intervento politico di stampo sovranazionale, in maniera simile, come già suggerito lo scorso anno dal CEO di OpenAI Sam Altman, al modo in cui viene gestita oggi la ricerca e lo sviluppo dell’energia nucleare.

Fonte: http://feeds.hwupgrade.it/